- 総合TOP

- 宇宙

- AI

- ロボット

- WEB3・メタバース

今やロボットは工場だけでなく、家庭やオフィスなどさまざまな場所でみられる存在です。さらに私たちは日々、いたるところにロボットがいる世界へと向かっています。

しかも現在のロボットは、ものごとを知覚し、自律的に決断し、学習することができます。また、人間の決断や感情にも大きな影響を与える存在であり、人間の選択や判断、感情は、もはや人間の自律的なものとはいえない状況もあります。

新しい技術には必ず検討すべきことがありますが、その中でも特に考えるべき点が多いのが、ロボットやAIだと指摘されています。そうしたニーズから提唱されるようになったのが「ロボット倫理学」です。

「ロボット倫理学」は何を対象とし、何を目指すものなのでしょうか。その意義とポテンシャルを探ります。

大学教員、ライター、編集ディレクター

博士(文学)。南山大学総合政策学部などで准教授、特任教授を歴任。現在は信州大学グローバル化推進センター非常勤講師。専門は日本語学、日本語教育。高等教育の他、文部科学省、外務省、厚生労働省などのプログラムに参画し、日本語教師育成、教材開発、辞書編集、リカレント教育、外国人就労・定着支援などに携わる。2019年からライター、編集ディレクターとしても働いている。

横内美保子

「ロボット倫理学」の背景

ロボット工学の発展は目覚ましく、ロボットは社会に浸透してきました。家事、娯楽、接客、介護、医療、警察、軍事、交通……、現在はさまざまな領域で多種多様なロボットが使われています。

社会は絶えず変化し、テクノロジーは進歩します。それにともない、それまでの倫理原則では対応しきれない新しい問題が生じます。特にロボットは、特定のタスクを効率よくこなす単なる道具ではなく、経済や産業の構造を変化させ、さらに人間の価値観や生き方にも大きな影響を与える可能性のある存在です。

たとえば、ペッパーなどのコミュニケーション・サービスを担うロボットや、子どもの世話をするロボット、性的サービスをするロボットは、人間と親密な関係を持つようにデザインされ、人間の感情をよみ、自らもまるで感情をもっているかのように振る舞います。

こうしたロボットが身近に増えた場合、私たちはモノ以上の存在として扱いたくなるのではないでしょうか。そして、ロボットが良いことをした場合には感謝し、逆に悪いことをした場合には道徳的な観点から怒ったりしたくなるのではないでしょうか。

このように、ロボットをどのような存在として受け止め、受け入れるかという問題が実際に生じつつあります。

こうした背景から、ロボットに関連する倫理問題について考え議論する「ロボット倫理学」が提唱されるようになりました。

分野的位置づけ

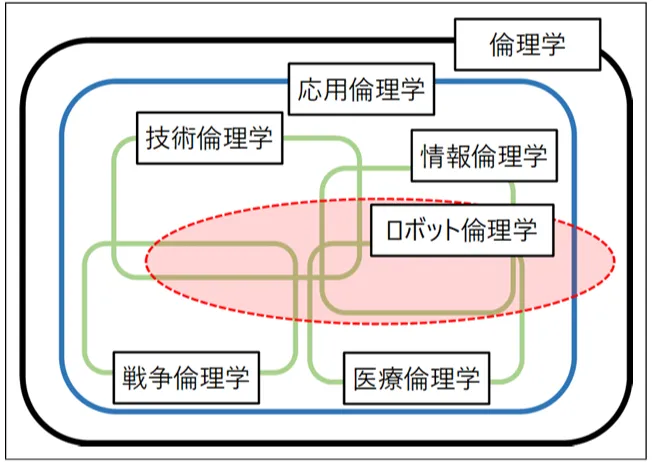

ロボット倫理学の研究者である久木田水生氏は、ロボット倫理学を、倫理学の下位分類である「応用倫理学」の一分野と位置づけています。

応用倫理学は個別の領域で生じる具体的・個別的な問題を扱います。ロボット倫理学ではもちろんロボットに関連する倫理的問題を扱いますが、ロボット技術は応用範囲が非常に広いため、医療倫理学、技術倫理学、情報倫理学、コンピュータ倫理学、ビジネス倫理学、戦争倫理学など、他のさまざまな分野とも重なります(図1)。

ロボットをどのような存在として受け入れるべきか

上述のように、ロボット倫理学が扱う問題は他のさまざまな分野と交わっていますが、ロボット倫理学だけで問われる固有の問題もあります。

それが、「ロボットをいかなる存在者として受け入れるべきか」という問題です。

ロボットは「道徳的行為者」となるか

「道徳的行為者」とは、道徳的に行為しうる主体を指します。

現在はロボットに道徳的行為者としての能力を持たせようとする研究が行われています。「機械倫理学」「人工道徳」と呼ばれる分野です。機械倫理をリードするスーザン・L.アンダーソン氏が開発しているシステムをみてみましょう。

アンダーソン氏らが開発しているのは、ケア・ロボットで、薬を飲む時間になると、患者に薬を渡すようにプログラミングされています。では、そこにどんな問題があるのでしょうか。

それは患者が薬を飲むことを拒否した場合にどうするか、という問題で、その際には以下のような選択肢があります。

(1)患者に薬を飲むように促す

(2)患者が薬を飲まないことを医者に知らせる

(3)そのまま放っておく

上の(1)・(2)を選んだ場合には患者の自律的な感情を損なう可能性が、(3)を選んだ場合には患者の健康を害する可能性があります。

人間のケアワーカーはそのときどきの状況に応じてどの選択が患者にとってベストであるかを判断しますが、アンダーソン氏のロボットはこうした判断を模倣することを目指しています。

ただし、「人間が従っている倫理的規則を明らかにし、それを機械にプログラムして実行させる」というパラダイムには2つのボトルネックがあります。

まず、仕事を遂行する際に直面する倫理的なジレンマ状況で、専門家がどのような規則に従っているのかが必ずしも明確ではないこと。次に、もし専門家が何らかの規則に従っていることが明確で、さらにその規則が機械でも理解できる場合であっても、それを実際のあらゆる状況に適用させるのは非常に困難であるという点です。

こうした際に、もしロボットが誤った判断をした場合には、誰が責任をとるのでしょうか。

コンピュータ倫理学に大きな影響を与えたヘレン・ニッセンバウム氏は、人間だけが責任を引き受ける行為主体であることを強調しました。

しかし、一方で、人間が本当に道徳的行為者であるのかさえも実は疑問なのです。道徳的行為者であるためには、自律的な意思決定能力をもつことが前提ですが、最近の社会心理学などの研究によって、人間の意思決定には環境的要因や無意識の役割が大きいことがわかってきています。

さらに現在、選択や判断のさまざまな場面において人間はAIのリコメンデーションシステムの影響を受けるようになっています。

人間の自律性は実際にはそれほど強固なものではなく、一方でロボットがますます自律性を増している現在にあっては、人間とロボットの類似点と相違点を明確にする研究はこれまで以上に重要になるでしょう。

ロボットは「道徳的被行為者」となるか

次に「道徳的被行為者」についてみていきましょう。道徳的被行為者とは、道徳的に配慮するべきだと考える対象を指します。

その対象範囲はこれまで歴史的に大きく変化してきました。かつてヨーロッパでは、白人、男性、成人だけに十分な合理的思考能力があると考えられていました。そのため、白人、男性、成人には道徳的な行為が可能であり、かつ道徳的配慮を受けるのに値する一方で、それ以外の存在には道徳的な権利はないとみなされていました。

しかし、やがて理論上はすべての人間が平等に道徳的権利を持つものと認識されるようになりました。そして現在では、少なくとも苦痛を感じる能力をもつ一部の動物も道徳的被行為者の仲間として認知されています。

では、ロボットのような人工物が道徳的配慮の対象となる可能性はあるのでしょうか。この問題に対しては、さまざまな考え方があります。

興味深い事例をみてみましょう。ロボット倫理学者のケイト・ダーリング博士はThe conferenceでのスピーチで、次のようなエピソードを紹介しています。

アメリカのBoston Dynamicsは人間や動物のような形をした軍用ロボットを作っています。その1つ、Spotという名前の、犬に似たロボットの動画が公開されました。

その動画の中では、1人の男性が思い切りスポットを蹴飛ばします。スポットはよろけながらも体勢を持ち直し前進しますが、しばらくしてもう1人の男性がもっと強くスポットを蹴りました。

それはスポットの安全性を示すためです。ところが、多くの人がこの動画に対して非常にネガティブな感情を抱き、SNSなどに非難の投稿をしました。また、動物愛護団体のPETAにも電話が殺到しました。本物の犬ではないのに、です。

こうした反応について、倫理学者たちはどのように考えているのでしょうか。

ある研究者は、倫理的に間違ったことだと述べています。なぜなら、人間の配慮や気遣いは限られたリソースであり、それをロボットに差し向けることは、人間が本来受けられるはずの配慮や気遣いを奪ってしまうからです。

また、他の研究者は、パイを奪うだけでなく、人間の、他者に共感する能力や対話する能力を弱め、私たちが他者とのコミュニケーションにおいて何を期待するのか、何を規範とするのかを変化させてしまうと考えています。

ロボット倫理学者のノエル・キャシーは、Spotに対する視聴者の反応に対して、

「私たちがロボットに対して倫理的な配慮をしなければならないのは、ロボットが痛みを感じるようになったときのみである」

とコメントしています。

一方で、道徳的配慮の対象を拡大すべく検討している研究者もいます。

たとえば2018年、1人の日本人男性がフィクションのキャラクター「初音ミク」と結婚式を挙げたことが話題になりました。彼にとってそのキャラクターはペルソナをもつ大切な存在です。であれば、従来の価値観によってこのような男性の生き方を非難するのではなく、テクノロジーや社会の変化に応じて新しい価値観を構築していくことも倫理学者の仕事の一部であると、久木田氏は述べています。

さらに、対象の性質によって道徳的配慮の対象を決定するアプローチそのものを批判する立場もあります。何らかのカテゴリーに属するものを道徳的配慮の対象とすることは、それ以外の対象を排除することを意味します。それは、西洋の倫理学が常に何かを排除し続けてきたことと重なります。

そのため、道徳的行為者と道徳的被行為者という二項対立的な図式を根底から問い直すべきだと唱える研究者もいるのです。

おわりに

ロボット倫理学では、ロボットに関連するさまざまな倫理問題について考え、議論しています。

本稿では、そのうち、「ロボットをどのような存在として受け入れるべきか」という重要な問に関する議論をとりあげました。それは翻って、人間とはどのような存在かについて考えることにもつながります。

ロボット倫理学で検討すべき問題はまだまだあります。次回は、別の観点からさらに掘り下げていきましょう。

資料一覧

久木田水生「ロボット倫理学」日本知能情報ファジィ学会誌『知能と情報』Vol.31, No.5(2019)p.133,135-137

佐々木拓「第3章 私のせいではない、ロボットのせいだ」『ロボットからの倫理学』(2017)名古屋大学出版会 p.52

久木田水生「第1章 機械の中の道徳」『ロボットからの倫理学』(2017)名古屋大学出版会 pp.12-13

The Conference「Kate Darling – Ethical issues in human-robot interaction」(2015年) 11:13~